“¿Tu sabes porque a mi se me entendió en todo el mundo? Por el acento”. Con esta frase Lola Flores “volvía a la vida” a principios de 2021 gracias a un vídeo modificado con inteligencia artificial para una campaña de la marca Cruzcampo. Fue el primer deepfake viral que apareció a principios del año 2021. Adivinar que esto era un “deepfake” fue fácil pues Lola había fallecido años antes, pero, ¿Qué ocurre cuando se trata de una persona que es suplantada? Necesitamos conocer en detalle el auge de los deepfakes, sus usos maliciosos y las implicaciones éticas, legales y psicológicas que conllevan. Además de conocer que medidas podemos tomar para por lo menos prevenir esta amenaza en constante evolución en la era de la inteligencia artificial.

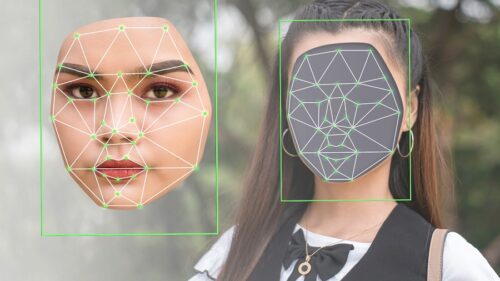

En los últimos años mucho se ha evolucionado en lo que se refiere a Inteligencia Artificial Generativa y con ello el auge de los deepfakes han puesto en riesgo la reputación de las personas y también de instituciones o incluso de paises, tanto es así que si alguien le da por crear nuestros “otros yo” pueden usurpar nuestra identidad, privacidad y reputación. La tecnología de los deepfakes ha experimentado un vertiginoso avance, lo que ha permitido que la creación y difusión de contenido manipulado sean más accesibles que nunca. Desde celebridades hasta personas comunes, cualquiera puede ser víctima de esta forma de engaño digital, y los números son alarmantes. De acuerdo con estadísticas proporcionadas por el Foro Económico Mundial (1), se ha registrado un alarmante aumento anual del 900% en los ataques de deepfake.

Un estudio conjunto de la Universidad Northwestern (2) y la Brookings Institution de Estados Unidos alerta sobre el peligro potencial que representa para la seguridad, especialmente en procesos políticos democráticos. Pero además sus usos preocupantes abarcan a conflictos bélicos o a la industria del porno no consensuado, con las mujeres siendo las principales víctimas.

Los deepfakes en las guerras

En el contexto del conflicto ruso-ucraniano, los investigadores resaltaron ejemplos impactantes de ‘deepfakes’, como la utilización de imágenes de videojuegos para respaldar mitos urbanos, un falso anuncio de paz del presidente ruso Vladimir Putin y la manipulación de un sitio web de noticias ucraniano para difundir un mensaje ficticio de rendición del presidente Volodymyr Zelensky (3).

Las conclusiones del estudio mostraban que el temor a los ‘deepfakes’ minaban la credibilidad de las imágenes relacionadas con el conflicto, lo que resultaba en una desconfianza que se extendía incluso a las imágenes legítimas. Asimismo, la investigación identificó teorías de conspiración en línea que hacían uso de ‘deepfakes’.

Esto nos lleva a un peligroso terreno en el que la percepción de la realidad se distorsiona y la desconfianza se convierte en la norma. La capacidad de los ‘deepfakes’ para engañar a nuestros sentidos y presentar una versión manipulada de la verdad provoca un estado de desinformación.

Deepfakes aplicados a lo pornográfico y erótico

Uno de los usos más preocupantes de los deepfakes es su aplicación en la industria del porno. Las mujeres son las principales víctimas de este fenómeno, ya que sus rostros pueden ser superpuestos en videos explícitos sin su autorización. Esta práctica plantea preocupaciones éticas, legales y de privacidad significativas. Las víctimas de deepfakes pornográficos se enfrentan a la invasión de su intimidad y a la difusión de contenido sexualmente explícito sin su consentimiento, lo que puede tener consecuencias devastadoras para su vida personal y profesional.

La red está repleta de ‘deepfakes’ sexuales de famosos, incluso en grandes portales de contenido para adultos. Basta con buscar en Google el nombre de cualquier ‘celebrity’ para encontrar contenido erótico o pornográfico en cuestión de segundos. Además, la demanda de este tipo de contenidos se ha disparado. Según un informe de Home Security (4) La pornografía deepfake representa el 98% de todos los vídeos deepfake online y el 99% del contenido pornográfico deepfake está compuesto por mujeres. Este documento resalta tambien que 7 de los 10 principales sitios web de pornografía albergan deepfakes.

Un ejemplo emblemático de esta problemática es el caso de la cantante Rosalía (5). Ella se vio afectada por la difusión de una fotografía manipulada en la que supuestamente aparecía haciendo topless. El reguetonero JC Reyes (Reyes Cortés) fue quien publicó la imagen en sus historias de Instagram, insinuando que Rosalía se la había enviado personalmente. Sin embargo, Reyes posteriormente confirmó que él mismo había editado la imagen con Photoshop.

La creciente accesibilidad de la inteligencia artificial (IA) y su aplicación en deepfakes ha exacerbado el problema. Inicialmente, estos deepfakes se centraron en famosos, pero su uso se ha extendido a individuos comunes y corrientes. Además, las víctimas pueden ser objeto de chantaje o acoso a través de la amenaza de liberar deepfakes dañinos.

Las Implicaciones Legales y Psicológica

El daño causado por los deepfakes puede ser devastador. Pueden socavar la reputación de las víctimas, afectar su empleabilidad, dañar sus relaciones personales y amorosas, y en última instancia, cambiar sus vidas para siempre.

La creación de deepfakes conlleva implicaciones legales importantes, especialmente en términos de protección de datos y privacidad. Los deepfakes a menudo utilizan datos personales reales, como rostros o voces, lo que constituye una violación de la normativa de protección de datos. La difusión de estos contenidos sin el consentimiento del afectado agrava aún más la vulneración de derechos, como el honor, la intimidad y la propia imagen.

Además de las implicaciones legales, los deepfakes también tienen un impacto psicológico en las víctimas. La ciberviolencia, ya sea a través de deepfakes falsos o reales, afecta la salud mental de las víctimas. La ansiedad, la depresión, las autolesiones y el suicidio son algunas de las consecuencias graves que pueden experimentar quienes son víctimas de abuso digital. La magnitud de las repercusiones psicológicas subraya la urgencia de abordar esta amenaza de manera efectiva.

Luchando contra los Deepfakes

La lucha contra los deepfakes es un desafío constante. Aunque se están desarrollando herramientas de detección de deepfakes, la velocidad a la que se producen nuevos contenidos falsos dificulta su control efectivo. Además, la legislación y regulación en torno a los deepfakes aún están en evolucionado y no se ha establecido con un normativa que sea capaz de garantizar la protección de los derechos y la privacidad de las personas.

Para abordar este problema, es fundamental fomentar la educación y la concienciación como pasa en muchas otras áreas de la ciberseguridad. Las personas deben ser capaces de reconocer y cuestionar la autenticidad de los contenidos que consumen provenientes de internet.Existen en la red herramientas de verificación que ayudan a detectar contenido manipulado. Una de ellas es la de la organización Sensity. AI y tambien existe un plugin con el nombre de Reality Defender, que instalado en el navegador detecta vídeos falsos, se pueden utilizar para rechazar los deepfakes

Como usuarios de “andar por casa” podemos tener en cuenta ciertos indicadores que pueden ayudar a identificar los deepfakes. Así en el caso de personas es importante observar los movimientos de los ojos en los vídeos, ya que los deepfakes a menudo presentan parpadeos poco naturales o la falta de ellos. Igualmente debemos analizar la sincronización de los movimientos labiales con el audio para detectar posibles desajustes. Mirar con detenimiento cada detalle del video es muy importante por eso también es necesario fijarse en el caso de las personas en la piel, pues hay veces que cambia por ejemplo alrededor del rostro, el cabello y los hombros. Otro aspecto importante es el contexto general del video donde merece la pena fijarse y observar las diferencias en la iluminación y las sombras en el rostro como posibles indicadores de la manupulacion audiovisual.

Además, es esencial verificar la fuente del contenido, ya que los deepfakes suelen circular con mayor frecuencia en plataformas menos reguladas. La combinación de estos factores puede ayudarnos a ser más cautos y críticos al consumir contenido en línea.

Un desafío constante en busca de la autenticidad

La proliferación de los deepfakes es una realidad alarmante que enfrenta la sociedad en la era de la inteligencia artificial. El rápido avance tecnológico ha hecho que la creación y difusión de contenido manipulado sean más accesibles que nunca, y las consecuencias son significativas. Las víctimas de deepfakes, en particular las mujeres, se enfrentan a invasiones de privacidad, daños a su reputación y graves repercusiones psicológicas.

La lucha contra los deepfakes es un desafío constante que requiere la colaboración de gobiernos, empresas tecnológicas y la sociedad en su conjunto. La educación y la conciencia pública son fundamentales para empoderar a las personas a reconocer y cuestionar la autenticidad de los contenidos en línea. En la red se deben implementar medidas más estrictas para detectar y eliminar los deepfakes, y se debe promover una cultura en línea que desaliente su difusión y consumo.

Es fundamental tomar medidas decididas y efectivas para salvaguardar los derechos, la privacidad y la seguridad de las personas en este siempre cambiante mundo digital. Si Lola flores reivindicaba la diversidad en aquel anuncio es ahora fundamental luchar contra la desinformación que provocan estos contenidos manipulados pues al final es una cuestión de la sociedad que y una prioridad que no puede esperar.

Referencias:

1- Bueermann, G.; Perucica, N. (2023).¿Cómo combatir el preocupante aumento del uso de deepfakes en la ciberdelincuencia?- World Economic Forum. https://es.weforum.org/agenda/2023/05/como-combatir-el-preocupante-aumento-del-uso-de-deepfakes-en-la-ciberdelincuencia/

2 – Morris, A. (2023). Deepfake challenges ‘will only grow’. Northwestern Now. https://news.northwestern.edu/stories/2023/01/deepfake-challenges-will-only-grow/

3- ProofPoint. (2023). Don’t Answer That! Russia-Aligned TA499 Beleaguers Targets with Video Call Requests. https://www.proofpoint.com/us/blog/threat-insight/dont-answer-russia-aligned-ta499-beleaguers-targets-video-call-requests

4 – Home Security Heroes – (2023) 2023 State of Deepfakes.https://www.homesecurityheroes.com/state-of-deepfakes/#targeted-individuals

5- Limón, R. (2023). De Rosalía al instituto: la inteligencia artificial generaliza la creación de imágenes pornográficas no consentidas. El Pais. https://elpais.com/tecnologia/2023-09-18/de-rosalia-al-instituto-la-inteligencia-artificial-generaliza-la-creacion-de-imagenes-pornograficas-no-consentidas.html