Editor en La Ecuación Digital. Analista y divulgador tecnológico con…

Después de Rubin y de la expansión de sus modelos abiertos, NVIDIA utilizó el CES 2026 para desplegar una tercera capa de su estrategia: la robótica basada en IA física. No como un laboratorio experimental, sino como un mercado que empieza a mostrar señales claras de madurez industrial.

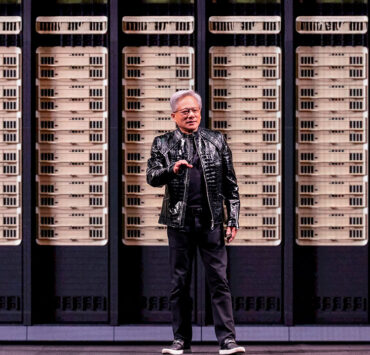

La puesta en escena fue deliberada. Sobre el escenario y en los anuncios asociados aparecieron robots móviles, manipuladores industriales y humanoides desarrollados por socios como Boston Dynamics, Caterpillar, Franka Robotics, NEURA Robotics, Humanoid y LG Electronics. El mensaje implícito era claro: la robótica ya no es una promesa lejana, sino una extensión natural del stack de IA que NVIDIA ha venido construyendo durante años.

El “ChatGPT moment” de la robótica y la IA física

Durante la presentación, Jensen Huang utilizó una expresión cargada de intención: “el momento ChatGPT para la robótica ya está aquí”. No se refería a un único producto, sino a una convergencia de factores que, por primera vez, hacen viable escalar robots más allá de tareas únicas y altamente programadas.

La clave está en la IA física: modelos capaces de percibir el entorno, razonar sobre él y planificar acciones en un mundo regido por leyes físicas, no por texto. Para Huang, los avances recientes en modelos fundacionales del mundo, simulación y razonamiento visual están desbloqueando aplicaciones que hasta ahora eran económicamente inviables o técnicamente frágiles.

Cosmos y GR00T: modelos abiertos para aprender y razonar en el mundo real

En el centro de esta estrategia se sitúan los nuevos modelos abiertos de NVIDIA para robótica. La compañía amplió su familia Cosmos con Cosmos Transfer 2.5 y Cosmos Predict 2.5, orientados a la generación de datos sintéticos físicamente plausibles y a la evaluación de políticas robóticas en simulación. A ellos se suma Cosmos Reason 2, un modelo vision-language diseñado para que máquinas y robots interpreten escenas físicas con mayor precisión.

Sobre esta base se apoya Isaac GR00T N1.6, el modelo VLA (visión, lenguaje y acción) abierto de NVIDIA para robots humanoides. A diferencia de enfoques más tradicionales, GR00T no se limita a ejecutar movimientos predefinidos, sino que combina razonamiento contextual con control de cuerpo completo. Esto permite entrenar robots que aprenden nuevas tareas sin partir de cero cada vez.

Fabricantes como Franka Robotics, NEURA Robotics y Humanoid ya están utilizando estos flujos de trabajo para simular, entrenar y validar comportamientos antes de llevarlos a hardware real. El objetivo es reducir el coste y el riesgo asociados a la experimentación directa en entornos físicos.

Simulación a escala: Isaac Lab-Arena y OSMO

Uno de los problemas históricos de la robótica ha sido la fragmentación de los flujos de desarrollo. Entrenar, evaluar y validar un robot suele implicar herramientas dispares, procesos manuales y una fuerte dependencia de hardware específico. NVIDIA intenta abordar ese cuello de botella con nuevos frameworks abiertos.

Isaac Lab-Arena es un entorno colaborativo para evaluación y benchmarking de políticas robóticas en simulación, diseñado para estandarizar pruebas y mejorar la robustez antes del despliegue. Al conectarse con benchmarks como Libero o Robocasa, introduce un lenguaje común para medir capacidades robóticas, algo que hasta ahora ha faltado en el sector.

Por su parte, OSMO actúa como un sistema de orquestación cloud-native que unifica todo el ciclo de desarrollo robótico. Desde generación de datos sintéticos hasta entrenamiento y pruebas software-in-the-loop, OSMO permite mover cargas de trabajo entre estaciones locales y nubes mixtas sin reconfigurar cada etapa. Empresas como Microsoft, a través de Azure Robotics Accelerator, ya lo integran en sus toolchains.

Robótica abierta: NVIDIA y Hugging Face como catalizadores

La robótica se ha convertido en la categoría de más rápido crecimiento en Hugging Face, y NVIDIA busca capitalizar ese impulso integrando sus modelos y librerías abiertas en LeRobot, uno de los frameworks open source más utilizados en la comunidad.

Esta colaboración conecta a los más de dos millones de desarrolladores de robótica de NVIDIA con los trece millones de creadores de IA de Hugging Face. Modelos GR00T, Isaac Lab-Arena y herramientas asociadas ya están disponibles para fine-tuning y evaluación, reduciendo de forma significativa la barrera de entrada.

El acuerdo también refuerza la interoperabilidad hardware-software. Robots como Reachy 2 y Reachy Mini pueden ejecutar modelos VLA sobre Jetson Thor o incluso sobre DGX Spark, habilitando experiencias locales con modelos de lenguaje, visión y voz sin depender constantemente de la nube.

Jetson Thor y el salto del centro de datos al edge

Si Rubin representa la IA a escala de centro de datos, Jetson Thor simboliza su traslado al borde industrial. Diseñado para humanoides y robots con capacidades de razonamiento, Thor proporciona la potencia necesaria para ejecutar modelos complejos en tiempo real, con restricciones de energía y latencia.

En el CES, múltiples fabricantes mostraron robots integrados con Jetson Thor. NEURA Robotics presentó humanoides de nueva generación, Richtech Robotics lanzó Dex, orientado a manipulación industrial avanzada, y LG Electronics mostró un robot doméstico capaz de realizar múltiples tareas en interiores. Boston Dynamics y otros actores históricos también han integrado Thor para mejorar navegación y manipulación.

Como complemento, el nuevo Jetson T4000, basado en arquitectura Blackwell, ofrece una vía de actualización para clientes de Jetson Orin, con hasta cuatro veces más rendimiento dentro de un presupuesto energético de 70 vatios. Su orientación es clara: llevar IA avanzada a máquinas autónomas en entornos donde el consumo y el coste son críticos.

La robótica como extensión natural del stack de IA

Más allá de los anuncios concretos, la lectura estratégica es coherente con todo lo presentado por NVIDIA en el CES 2026. La robótica aparece como la siguiente plataforma computacional, una que exige modelos que entiendan el mundo, simulación masiva para entrenarlos y hardware capaz de ejecutar razonamiento en tiempo real en el edge.

Huang lo expresó de forma implícita al insistir en que los robots del futuro no serán máquinas de tarea única, sino sistemas generalistas-especialistas que aprenden rápido y se adaptan a contextos cambiantes. Para lograrlo, el stack debe ser completo: modelos abiertos, datos, simulación, orquestación y computación en el borde.

La incógnita, una vez más, no es tecnológica. Las demostraciones y la adopción por parte de socios industriales sugieren que el enfoque funciona. La pregunta es si el ecosistema será capaz de absorber esta complejidad y convertirla en productos escalables, fiables y económicamente sostenibles. Si lo consigue, la robótica podría convertirse en el siguiente gran mercado definido por la inteligencia artificial.

Editor en La Ecuación Digital. Analista y divulgador tecnológico con más de 30 años de experiencia en el estudio del impacto de la tecnología en la empresa y la economía.