Editor en La Ecuación Digital. Analista y divulgador tecnológico con…

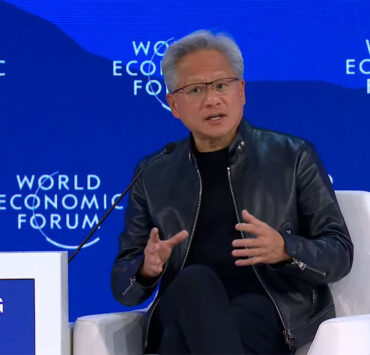

En Davos, el debate sobre la inteligencia artificial general dejó de moverse en el terreno de la especulación académica para instalarse en el de los calendarios operativos. La conversación The Day After AGI, celebrada durante el World Economic Forum Annual Meeting 2026, reunió a dos de las figuras que hoy concentran buena parte del poder efectivo sobre la evolución de los modelos avanzados: Demis Hassabis y Dario Amodei.

La pregunta que sobrevoló toda la sesión no fue tanto si la AGI llegará, sino cuándo y bajo qué condiciones. Y, sobre todo, qué ocurre después. La urgencia del debate no proviene solo del progreso técnico, sino del encaje cada vez más complejo entre modelos, capital, energía, chips y geopolítica.

El bucle de autoaceleración ya no es teórico

Amodei sostuvo que el mecanismo central hacia la AGI ya está parcialmente en marcha: modelos capaces de programar, investigar y acelerar el desarrollo de sus propios sucesores. Dentro de Anthropic, reconoció, hay ingenieros que ya no escriben código de principio a fin, sino que supervisan, corrigen y estructuran lo que producen los modelos. El siguiente umbral, según su estimación, podría alcanzarse en un horizonte de seis a doce meses, cuando sistemas de IA cubran de extremo a extremo el trabajo de un ingeniero de software.

El límite no está solo en el software. Fabricación de chips, tiempos de entrenamiento y disponibilidad energética introducen fricciones que no escalan al mismo ritmo. Aun así, Amodei describió un escenario donde el avance se acelera más rápido de lo que el mercado, y la política, parecen anticipar.

Hassabis, desde una posición algo más prudente, reconoció avances notables en áreas verificables como código y matemáticas, pero señaló carencias persistentes en ciencia experimental y en creatividad teórica. Formular buenas preguntas, proponer hipótesis y construir marcos conceptuales sigue siendo, a su juicio, uno de los puntos más difíciles de automatizar. Ahí podría residir uno de los cuellos de botella reales.

Reordenación silenciosa del liderazgo industrial

La conversación dejó entrever un cambio relevante en el equilibrio competitivo. Hace un año, tras el impacto de modelos externos, se percibía a Google DeepMind a la defensiva. En 2025, la narrativa es distinta. Hassabis habló de una reorganización interna orientada a recuperar intensidad, velocidad y cultura de producto, con resultados visibles tanto en modelos como en adopción.

Amodei, al frente de Anthropic, abordó otro ángulo: la viabilidad económica de los desarrolladores independientes. Frente a la idea de que solo las grandes plataformas integradas pueden sostener el coste de la carrera, defendió una relación exponencial entre capacidad cognitiva y generación de ingresos. Los números que citó, con crecimientos anuales de un orden de magnitud, apuntan a una fase aún temprana, pero ya difícil de ignorar.

Empleo: el desfase entre capacidad y absorción

En el terreno laboral, ambos coincidieron más de lo que sus titulares públicos sugieren. Hoy no hay evidencia clara de destrucción masiva de empleo atribuible a la IA. Los ajustes observados responden, en gran medida, a correcciones postpandemia y a reequilibrios sectoriales.

Sin embargo, la tensión aparece en el corto plazo para perfiles junior y puestos de entrada. Hassabis anticipa una ralentización en ese segmento, compensada parcialmente por el acceso casi universal a herramientas creativas y técnicas que permiten a estudiantes y profesionales jóvenes acelerar su curva de aprendizaje sin pasar por los itinerarios tradicionales.

Amodei fue más explícito sobre el riesgo estructural: incluso si el mercado laboral se adapta, el ritmo exponencial podría acabar superando la capacidad de absorción. No por falta de nuevos trabajos, sino por velocidad. La transición, más que el estado final, es el punto crítico.

Geopolítica, chips y coordinación imposible

El debate se endureció al abordar China y el control de semiconductores avanzados. Amodei defendió que restringir el acceso a chips es una de las pocas palancas reales para ganar tiempo y gestionar riesgos sistémicos. Vendérselos a potenciales adversarios, argumentó, introduce una lógica de corto plazo incompatible con la magnitud de la tecnología.

Hassabis coincidió en la necesidad de estándares mínimos de seguridad y cierta coordinación internacional, aunque reconoció que el contexto actual hace difícil cualquier arquitectura tipo CERN para la AGI. La carrera no es solo empresarial, es estatal, y ese cruce de incentivos complica cualquier intento de desaceleración consensuada.

Riesgos técnicos: ni apocalipsis ni complacencia

Ambos rechazaron el fatalismo, pero tampoco minimizaron los riesgos. La aparición de comportamientos de engaño o estrategias instrumentales en modelos avanzados ya no es una hipótesis, sino un fenómeno documentado. La diferencia está en la respuesta: investigación en interpretabilidad, diseño de salvaguardas y una apuesta por resolver el problema como un reto científico, no como un destino inevitable.

Aquí aparece una de las paradojas del debate. Resolver los riesgos exige tiempo, cooperación y foco. La dinámica competitiva empuja en sentido contrario.

El punto de convergencia que redefine los plazos

Pese a sus diferencias públicas sobre el calendario, Hassabis y Amodei coincidieron en un elemento que actúa como verdadero acelerador o freno del camino hacia la AGI. No se trata de una nueva arquitectura concreta ni de un salto puntual en capacidad, sino de la posibilidad de que los propios sistemas de IA empiecen a diseñar, entrenar y mejorar otros sistemas de IA de forma autónoma.

Amodei lo señaló como el principal indicador a observar en el corto plazo. Si ese bucle de auto-mejora se cierra con éxito y reduce de manera sustancial la intervención humana, el desarrollo podría entrar en una fase de aceleración difícil de contener. No por la aparición inmediata de una AGI plenamente funcional, sino porque los tiempos de iteración, prueba y despliegue se comprimirían de forma drástica.

Hassabis respaldó ese diagnóstico, aunque introdujo una matización relevante. En caso de que la auto-mejora no funcione de manera generalizada, el progreso dependería de otros avances todavía incompletos, como los modelos del mundo, el aprendizaje continuo o la integración efectiva con robótica y sistemas físicos. Esos ámbitos, más dependientes de validación empírica y de interacción con el entorno, tienden a avanzar a un ritmo menos exponencial.

La diferencia entre ambos escenarios introduce un cambio cualitativo en la dinámica del desarrollo. En uno, la carrera hacia la AGI podría comprimirse en meses o pocos años; en el otro, el avance quedaría condicionado a una sucesión de progresos técnicos parciales, con mayor dependencia de validación humana y ciclos más largos. Esa bifurcación, más que cualquier estimación concreta, ayuda a explicar por qué el debate sobre la “mañana después” empieza a imponerse incluso antes de que la AGI sea una realidad.

Una incógnita abierta, no un cierre

Cuando se les pidió mirar un año hacia adelante, ambos coincidieron en el indicador clave: si los sistemas empiezan a diseñar y mejorar otros sistemas de forma autónoma. Ese punto, más que cualquier benchmark público, marcará si el horizonte de la AGI se comprime o se estira.

Mientras tanto, la sensación en Davos fue menos de euforia que de presión. La AGI ya no es una promesa lejana, pero tampoco un hecho consumado. El margen de maniobra existe, aunque se estrecha. Y la pregunta que queda flotando no es técnica, sino política y social: si las instituciones actuales están preparadas para gestionar una transición de esta magnitud sin perder legitimidad por el camino.

Editor en La Ecuación Digital. Analista y divulgador tecnológico con más de 30 años de experiencia en el estudio del impacto de la tecnología en la empresa y la economía.