Fujitsu y el Centro de Información Cuántica y Biología Cuántica de la Universidad de Osaka han presentado una combinación de arquitectura y software que, según sus pruebas, recorta de forma drástica los recursos necesarios para llevar cálculos químicos complejos a una etapa temprana de computación cuántica tolerante a fallos, la llamada early-FTQC . El foco está en un problema muy concreto, pero con ramificaciones industriales amplias: estimar energías moleculares con precisión suficiente como para orientar el diseño de fármacos y materiales, un tipo de cálculo que hoy se atasca en los límites de memoria y tiempo de la computación clásica cuando las moléculas crecen y la química se vuelve “real”.

El anuncio aterriza en dos piezas técnicas que se refuerzan entre sí: la arquitectura STAR en su versión 3 y una técnica de optimización de modelos moleculares aplicada durante la generación de circuitos cuánticos. La promesa no es menor. Hablan de pasar de escalas temporales “de milenios” con versiones anteriores a ventanas de días o semanas en un escenario early-FTQC, un terreno intermedio que, en la práctica, intenta extraer valor antes de que existan máquinas cuánticas plenamente tolerantes a fallos con millones de qubits.

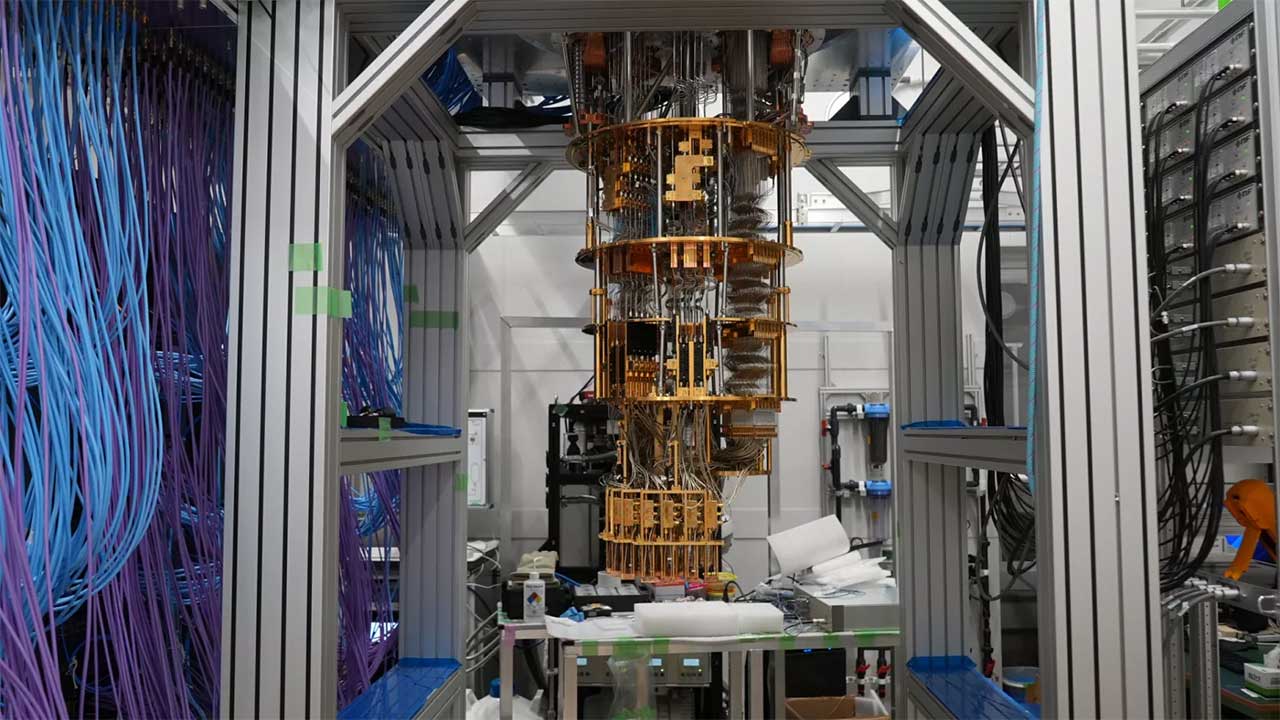

Para entender por qué este tipo de avance se mide en qubits, puertas y tasas de error conviene recordar el cuello de botella de la computación cuántica actual. Los qubits físicos, los elementos básicos de hardware, son frágiles: se descoheren y cometen errores. La tolerancia a fallos se apoya en corrección de errores, que “codifica” qubits lógicos robustos a partir de muchos qubits físicos. Ese salto multiplica recursos. Por eso, cuando se habla de aplicaciones prácticas, aparece a menudo la cifra de millones de qubits, no como un objetivo de marketing, sino como una consecuencia de la contabilidad de errores y de la profundidad de los circuitos necesarios.

En ese marco, Fujitsu y Osaka llevan desde 2023 empujando STAR como una arquitectura orientada a reducir el coste de la tolerancia a fallos. La versión 1 se anunció el 23 de marzo de 2023 y la versión 2 el 28 de agosto de 2024. La idea central, según describen, es apoyarse en puertas de rotación de fase “altamente eficientes y únicas” frente a arquitecturas FTQC convencionales basadas en puertas T, un tipo de puerta lógica que suele ser cara en términos de corrección de errores y que, en muchos esquemas, domina el coste total del cómputo. STAR v2 ya había ampliado la escala de computación y se había presentado como un camino hacia cálculos early-FTQC en propiedades de materiales en estado sólido, por ejemplo superconductividad a altas temperaturas. Sin embargo, el salto a química molecular compleja seguía siendo prohibitivo.

La versión 3, tal como la describen, introduce un matiz relevante: integra puertas de rotación de fase con puertas T lógicas y con ello eleva la precisión computacional en más de 10 veces respecto a STAR v2. En términos prácticos, esa mejora pretende permitir circuitos útiles con el mismo número de qubits y, además, relajar requisitos sobre la tasa de error de los qubits físicos. Es un punto delicado, porque la tasa de error es una de las variables que más condiciona el tamaño del “sobrecoste” de corrección de errores. Si el hardware tolera un error físico mayor sin disparar recursos, el umbral de entrada para ejecutar algoritmos largos se vuelve menos exigente.

La segunda pieza es software, pero no en el sentido genérico de “optimización”. Se trata de una técnica de optimización de modelos moleculares pensada para usarse con STAR v3 durante la traducción de un modelo químico a un circuito cuántico. En química cuántica, el modelo de una molécula se expresa como una suma de términos (por ejemplo, en un Hamiltoniano), y muchos métodos intentan explotar que no todos los términos contribuyen igual al resultado. Fujitsu y Osaka describen que su técnica parte de enfoques que descomponen el modelo en múltiples términos y aplican selectivamente dos técnicas, evolución temporal y muestreo aleatorio, según la importancia de cada término. La novedad, según el comunicado, está en “reconfigurar” el modelo manteniendo la precisión de la aproximación, redistribuir la importancia de los términos y ajustar el equilibrio entre ambas técnicas para minimizar el número de puertas del circuito. En computación cuántica, menos puertas suele equivaler a menos tiempo y menos exposición al error, dos variables que se retroalimentan.

La validación que presentan se apoya en tres casos de uso con nombres propios, elegidos por su relevancia industrial y por su dificultad computacional. Primero, el citocromo P450, una familia de enzimas oxidantes muy presente en metabolismo de fármacos y, por extensión, en etapas de descubrimiento y optimización de compuestos. Segundo, clústeres de hierro-azufre, motivos catalíticos que aparecen en proteínas implicadas en síntesis de amoníaco y metabolismo energético. Tercero, catalizadores de rutenio, habituales en química sintética. El mensaje de fondo es que no están midiendo sobre moléculas “de juguete”, sino sobre sistemas que, en su formulación precisa, empujan al límite a los métodos clásicos.

Aquí aparece una tensión interesante. Por un lado, el comunicado afirma que “en la actualidad” los cálculos energéticos precisos de estas moléculas no son viables con ordenadores clásicos por limitaciones de memoria. Por otro, la industria química y farmacéutica lleva décadas usando aproximaciones clásicas (DFT, métodos post-Hartree-Fock, modelos híbridos) que sí producen resultados útiles, aunque con compromisos de precisión y escalabilidad. Lo que Fujitsu y Osaka están poniendo sobre la mesa es el acceso, al menos en teoría, a un régimen de precisión y tamaño que esos métodos no alcanzan de forma general, especialmente cuando se busca capturar correlación electrónica fuerte en sistemas grandes. El matiz importa: no se trata de sustituir el flujo de trabajo clásico de mañana, sino de abrir una vía para problemas donde el coste de la aproximación se vuelve un freno.

En números, la arquitectura STAR v3 reduciría el número de qubits necesarios para estos cálculos a entre 1/15 y 1/80 frente a arquitecturas FTQC convencionales. La horquilla es amplia, lo que sugiere que el beneficio depende del tipo de molécula y del circuito resultante, algo habitual en optimización cuántica. Además, afirman que los cálculos serían viables en ordenadores cuánticos early-FTQC incluso si la tasa de error físico de los qubits se relaja del 0,01% al 0,10%. Ese salto de un orden de magnitud es relevante porque muchas plataformas de hardware compiten precisamente por bajar el error físico, y no todas avanzan al mismo ritmo.

El otro indicador es el tiempo. La optimización de modelos moleculares reduciría el tiempo de cálculo en tres órdenes de magnitud respecto a no usarla. Con esa técnica, Fujitsu y Osaka sitúan los tiempos en torno a 35 días con una tasa de error del 0,10% y alrededor de 10 días con una tasa del 0,01%. Son cifras que, aun siendo largas para un ciclo de diseño iterativo, entran en un rango que algunas organizaciones podrían considerar “operable” si el resultado aporta una señal diferencial, por ejemplo para seleccionar candidatos o descartar rutas sintéticas. Aunque a menudo se pasa por alto, en I+D industrial el tiempo de cómputo no se evalúa solo en horas, sino en coste de oportunidad y en capacidad de reducir experimentación física.

El concepto early-FTQC funciona aquí como un puente estratégico. La computación cuántica tolerante a fallos “plena” sigue asociada a máquinas grandes y caras, y su calendario es incierto. En cambio, una etapa temprana tolerante a fallos intenta capturar valor con menos qubits lógicos, circuitos optimizados y supuestos realistas sobre error. Eso no elimina la complejidad de la corrección de errores, pero desplaza el umbral de entrada. En contraste con la narrativa de “esperar a la máquina perfecta”, este tipo de trabajo se centra en ingeniería de recursos: qué se puede ejecutar antes, con qué precisión y bajo qué condiciones.

Fujitsu y la Universidad de Osaka señalan como siguiente paso continuar avanzando en STAR y en la optimización de modelos moleculares, ampliando el rango de aplicaciones prácticas en la era early-FTQC. Mencionan descubrimiento de fármacos, nuevos materiales y finanzas, un trío habitual en la agenda cuántica corporativa. La diferencia, en este caso, es que el comunicado aporta métricas de qubits, tasas de error y tiempos, que permiten discutir viabilidad con algo más de granularidad.

Queda, aun así, una incógnita que condiciona la lectura empresarial: la distancia entre una validación de recursos y una ejecución real en hardware. El comunicado habla de viabilidad en early-FTQC, pero el mercado todavía está construyendo máquinas capaces de sostener qubits lógicos estables con circuitos largos y con tasas de error efectivas compatibles con química de alta precisión. Fujitsu apunta a dos palancas para acortar tiempos en el futuro, reducir aún más el error físico y paralelizar con múltiples sistemas cuánticos. Si esa paralelización se materializa, el debate pasará de “si se puede” a “cuánto cuesta por cálculo” y “qué parte del pipeline de I+D merece ese coste”. Ahí es donde la computación cuántica, por fin, suele dejar de ser un laboratorio y empieza a parecerse a una decisión de inversión.