Editor en La Ecuación Digital. Analista y divulgador tecnológico con…

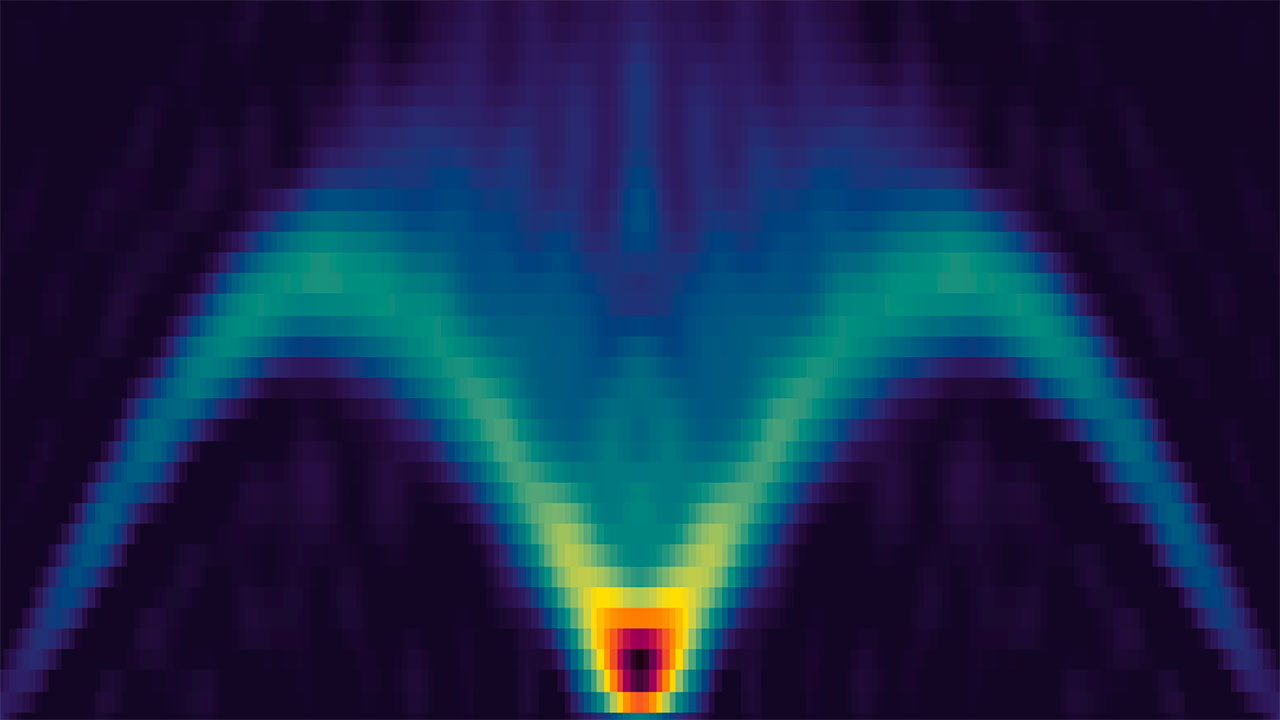

La computación cuántica ha transitado durante años por una delgada línea entre la promesa teórica y la limitación técnica. Sin embargo, la frontera que separa el cálculo experimental de la utilidad científica real parece haberse estrechado. Un reciente trabajo conjunto entre IBM y el Centro de Ciencias Cuánticas del Departamento de Energía de EE. UU. ha logrado lo que hasta hace poco se consideraba inabordable: simular con precisión materiales magnéticos reales, obteniendo resultados que coinciden con los datos obtenidos en laboratorios físicos mediante la dispersión de neutrones.

Este avance no solo valida la capacidad de los procesadores actuales para ejecutar tareas complejas, sino que plantea una interrogante sobre el papel que desempeñarán estas máquinas en la arquitectura de la supercomputación moderna. Ya no se trata únicamente de demostrar que un cúbit puede mantener la coherencia, sino de si esa coherencia es suficiente para replicar la física de un cristal magnético como el $KCuF_3$.

La superación del muro clásico

El diseño de nuevos materiales, desde superconductores de alta temperatura hasta baterías con densidades energéticas disruptivas, siempre ha chocado con el mismo muro: la imposibilidad de los ordenadores clásicos para modelar el comportamiento cuántico de forma exacta.

A medida que aumenta el número de partículas en un sistema, la complejidad del cálculo crece exponencialmente, obligando a los investigadores a recurrir a aproximaciones que, a menudo, pierden matices críticos por el camino.

En este escenario, el equipo liderado por instituciones como el Laboratorio Nacional de Oak Ridge, la Universidad de Purdue e IBM, ha utilizado un enfoque de supercomputación centrado en la computación cuántica. La clave de esta metodología reside en no intentar que el ordenador cuántico trabaje de forma aislada, sino integrarlo en un flujo de trabajo donde la computación clásica gestiona las partes del algoritmo más eficientes para su arquitectura, mientras que el hardware cuántico se encarga de las dinámicas de espín que resultan inmanejables para el silicio tradicional.

Arnab Banerjee, profesor de Física y Astronomía en la Universidad de Purdue, reconoce que existe una vasta cantidad de datos sobre materiales magnéticos que la ciencia clásica no ha podido descifrar completamente. Según Banerjee, el uso de procesadores cuánticos para comprender estas simulaciones y comparar datos experimentales es un hito que el sector ha perseguido durante una década. La capacidad de capturar propiedades dinámicas clave en un cristal bien caracterizado como el $KCuF_3$ sugiere que estamos ante un cambio de paradigma en el instrumental científico.

El factor crítico de la tasa de error

Uno de los mayores obstáculos para la adopción empresarial de la tecnología cuántica ha sido la fragilidad de sus componentes. Los errores en las puertas lógicas pueden corromper el resultado de una simulación en milisegundos. No obstante, los resultados presentados por IBM subrayan que las mejoras en la escala y, sobre todo, en la reducción de las tasas de error de dos cúbits, han alcanzado un punto de inflexión.

Abhinav Kandala, científico investigador principal en IBM, vincula directamente el éxito de estas simulaciones a la calidad del hardware actual. La precisión lograda permite ahora a los investigadores ser optimistas respecto a la extensión de estos modelos a dimensiones superiores y materiales con interacciones más complejas. Si bien los procesadores actuales todavía no son perfectos, la combinación de hardware mejorado y algoritmos de mitigación de errores está permitiendo realizar predicciones que antes requerían una fidelidad inalcanzable.

Esta evolución técnica impacta directamente en la percepción del riesgo para directivos y responsables tecnológicos. La pregunta ya no es si la computación cuántica funcionará, sino cuándo será económicamente viable integrarla en los procesos de I+D. La respuesta parece residir en modelos híbridos, donde la programabilidad de un procesador cuántico universal ofrece una versatilidad que los simuladores específicos de laboratorio no pueden igualar.

Derivadas en la industria y la ciencia aplicada

La capacidad de simular materiales no es un ejercicio académico vacío. En sectores como el de la energía, comprender la dinámica de los espines y los electrones en materiales complejos es fundamental para el desarrollo de nuevos conductores. En el ámbito de la salud, la simulación de proteínas y moléculas a gran escala, como las realizadas recientemente en colaboración con la Clínica de Cleveland, abre la puerta a un diseño de fármacos mucho más preciso y eficiente.

Allen Scheie, físico del Laboratorio Nacional de Los Alamos, califica la coincidencia entre los datos experimentales y la simulación como la más impresionante vista hasta la fecha. Este nivel de fidelidad eleva el listón de las expectativas corporativas. Sin embargo, el camino hacia la comercialización masiva aún presenta tensiones.

Aunque las simulaciones son precisas, la infraestructura necesaria para mantener estos sistemas operativos sigue siendo costosa y compleja, lo que sugiere que, a corto plazo, el acceso a estas capacidades se realizará mayoritariamente a través de modelos de computación en la nube.

Además, el estudio destaca que el enfoque ya se ha extendido más allá de los cristales magnéticos simples. La versatilidad del hardware permite simular clases de materiales con interacciones que desafían las categorías convencionales. Esta flexibilidad es lo que Travis Humble, director del Centro de Ciencias Cuánticas de Oak Ridge, identifica como la demostración definitiva del impacto que la computación cuántica tendrá en los flujos de trabajo de descubrimiento científico.

Un ecosistema en transformación

La integración de la computación cuántica en los laboratorios nacionales estadounidenses refleja una tendencia global: la tecnología está dejando de ser un área de investigación puramente física para convertirse en una herramienta de ingeniería. Los resultados obtenidos con el $KCuF_3$ se suman a otros hitos recientes, como la simulación de una molécula de media Möbius, consolidando un catálogo de aplicaciones que ya no dependen de la llegada de la «tolerancia a fallos» total para aportar valor.

Esta progresión, no obstante, obliga a las empresas a replantear sus estrategias de talento y computación. La supercomputación ya no se entiende como un bloque monolítico de CPUs y GPUs, sino como un entramado donde los procesadores cuánticos actúan como aceleradores especializados para problemas específicos de la materia.

El éxito de la colaboración entre IBM y el Departamento de Energía subraya que la soberanía tecnológica y el liderazgo industrial en las próximas décadas podrían depender de la capacidad de dominar estos flujos de trabajo híbridos.

Pese a los avances, queda por ver cómo escalarán estas soluciones cuando se enfrenten a materiales cuyas propiedades sean totalmente desconocidas, donde no exista un experimento previo con neutrones para validar el resultado.

Editor en La Ecuación Digital. Analista y divulgador tecnológico con más de 30 años de experiencia en el estudio del impacto de la tecnología en la empresa y la economía.