La frontera de la inteligencia artificial ha dejado de medirse únicamente por la potencia bruta del silicio para centrarse en la orquestación de sistemas complejos. Con la presentación de la plataforma Vera Rubin, NVIDIA desplaza el foco desde el chip individual hacia el centro de datos como una unidad de computación coherente. Esta nueva arquitectura, que entra ahora en producción, no solo busca acelerar el entrenamiento de modelos masivos, sino resolver el cuello de botella crítico de la inferencia agéntica: la capacidad de las máquinas para razonar, validar resultados y operar de forma autónoma con latencias mínimas.

El despliegue anunciado durante el GTC 2026 incluye siete nuevos componentes clave que abarcan desde la CPU Vera hasta la GPU Rubin, integrando por primera vez de forma nativa la tecnología de Groq tras su reciente incorporación al ecosistema de la firma de Santa Clara. Para los directivos y responsables tecnológicos en España, este movimiento supone un cambio de paradigma en la inversión de infraestructura; ya no se trata de adquirir servidores, sino de configurar factorías de IA donde el cómputo, la red y el almacenamiento funcionan bajo un mismo diseño lógico.

El salto hacia los sistemas a escala de rack

La industria tecnológica está abandonando la disposición de componentes discretos en favor de sistemas integrados a escala de rack y POD. Jensen Huang, fundador y CEO de NVIDIA, define este momento como un punto de inflexión generacional. Según explica el directivo, la plataforma ha sido concebida para alimentar todas las fases de la IA, desde el pre-entrenamiento hasta el escalado en tiempo de prueba. Esta visión es compartida por figuras de peso en el sector como Sam Altman, CEO de OpenAI, quien sostiene que esta infraestructura permitirá ejecutar modelos y agentes más potentes a una escala masiva, una necesidad imperativa ante la creciente complejidad de los flujos de trabajo actuales.

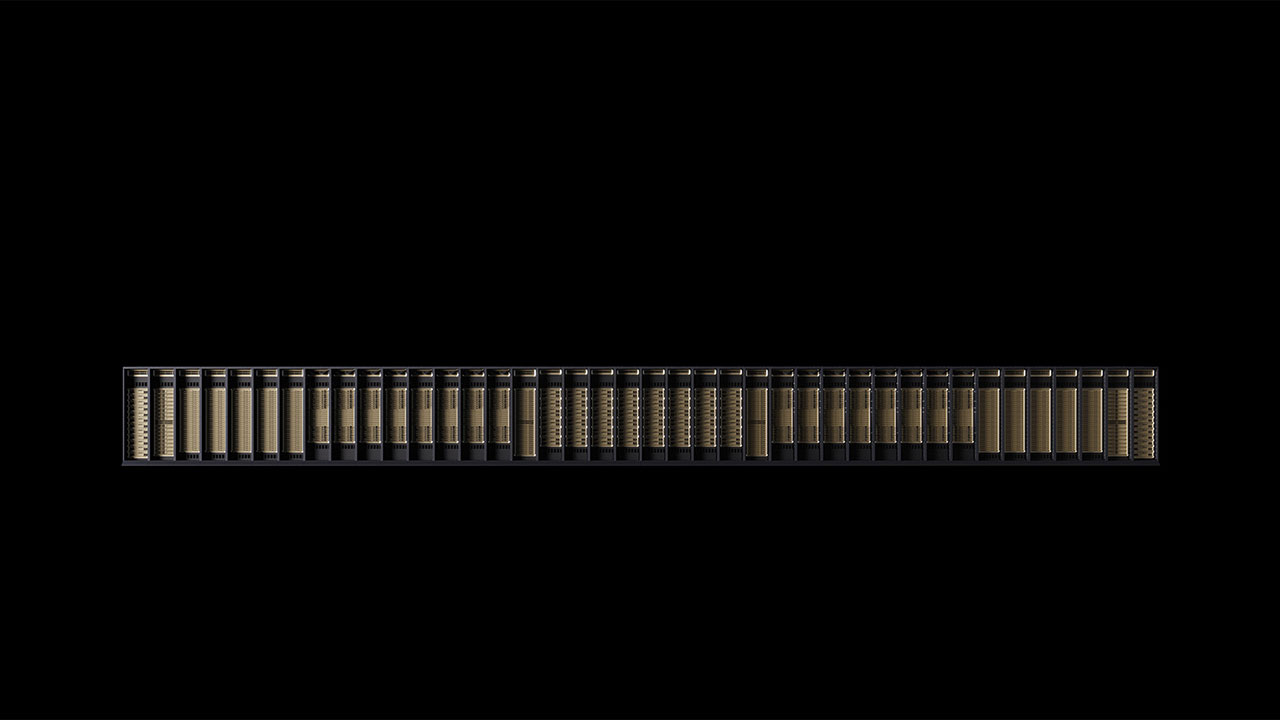

Uno de los pilares de esta propuesta es el rack NVIDIA Vera Rubin NVL72. Este sistema integra 72 GPUs Rubin y 36 CPUs Vera mediante el interconector NVLink 6. Las métricas de rendimiento sugeridas por la compañía apuntan a una eficiencia disruptiva: la capacidad de entrenar modelos de tipo mixture-of-experts utilizando apenas una cuarta parte de las GPUs necesarias en la anterior plataforma Blackwell. No obstante, el avance más significativo para el balance de resultados de las empresas reside en la inferencia, donde se proyecta un rendimiento por vatio hasta 10 veces superior, reduciendo el coste por token a una décima parte del valor actual.

La especialización del hardware: CPUs y LPUs

A diferencia de las arquitecturas tradicionales donde la CPU quedaba relegada a tareas de gestión, en el ecosistema de Vera Rubin el procesador central asume un rol protagonista en el aprendizaje por refuerzo. Los entornos de IA agéntica requieren una validación constante de los resultados generados por las GPUs, una tarea que demanda una alta capacidad de procesamiento de hilo único. El rack de CPUs Vera, compuesto por 256 procesadores refrigerados por líquido, promete ejecutar estas tareas de validación un 50% más rápido que las soluciones convencionales, permitiendo que el ciclo de razonamiento de la IA sea fluido y continuo.

Por otro lado, la integración del NVIDIA Groq 3 LPX introduce el concepto de LPU (Language Processing Unit) dentro de la fábrica de IA. Este componente está diseñado específicamente para mitigar la latencia en modelos de billones de parámetros. Al combinar las capacidades de la GPU Rubin con el determinismo de la LPU de Groq, el sistema puede alcanzar un rendimiento de inferencia hasta 35 veces superior por megavatio. Esta asimetría en el diseño busca maximizar el aprovechamiento de la memoria SRAM integrada y el ancho de banda, permitiendo que las interacciones con agentes de IA mantengan la coherencia incluso en contextos de millones de tokens.

Almacenamiento nativo y memoria de contexto

La persistencia de la información en los flujos de trabajo de larga duración es otra de las tensiones que Vera Rubin intenta resolver. El sistema de almacenamiento BlueField-4 STX funciona como una extensión de la memoria de la GPU a través de todo el POD. Mediante el nuevo marco de trabajo DOCA Memos, esta infraestructura gestiona de forma dedicada el almacenamiento de la caché clave-valor (KV cache), esencial para que los agentes de IA recuerden el contexto de interacciones previas.

Timothée Lacroix, cofundador y CTO de Mistral AI, destaca que esta capacidad de memoria de contexto es crítica para mantener la velocidad cuando se razona sobre conjuntos de datos masivos. Al descargar estas tareas de la computación general, la eficiencia energética del sistema mejora sensiblemente, permitiendo servicios de IA más escalables sin disparar el consumo eléctrico del centro de datos.

Sostenibilidad y el desafío energético en el CPD

El crecimiento exponencial de la IA plantea un dilema energético que las empresas españolas, sujetas a normativas de sostenibilidad cada vez más estrictas, deben considerar. La respuesta de NVIDIA a esta problemática es la plataforma DSX, que introduce la gestión dinámica de la potencia. Según los datos técnicos facilitados, la implementación de DSX Max-Q permite desplegar hasta un 30% más de infraestructura dentro de un límite de potencia fijo en el centro de datos.

Más ambiciosa es la propuesta de DSX Flex, un software diseñado para convertir las factorías de IA en activos flexibles para la red eléctrica, capaces de aprovechar energía excedente que de otro modo quedaría sin uso. Esta integración entre hardware, refrigeración líquida y software de gestión busca optimizar la métrica de tokens por vatio, asegurando que el escalado de la capacidad de cómputo no sea linealmente proporcional al aumento del gasto energético.

Disponibilidad y ecosistema de mercado

La adopción de Vera Rubin no será inmediata, pero su hoja de ruta ya está trazada para la segunda mitad de este año. La plataforma contará con el respaldo de los principales proveedores de servicios en la nube a nivel global, incluidos AWS, Google Cloud y Microsoft Azure, además de fabricantes de sistemas como Dell Technologies, HPE, Lenovo y Cisco. Para el directivo tecnológico, esto significa que la arquitectura estará disponible tanto en modelos de consumo por uso como en implementaciones on-premise para aquellas organizaciones que requieran soberanía total sobre sus datos.

Aunque las promesas de rendimiento son elevadas, la implementación real de estos sistemas agénticos dependerá de la capacidad de las organizaciones para adaptar sus arquitecturas de datos a este modelo de «factoría».

La viabilidad técnica del razonamiento autónomo a escala parece haber encontrado su respuesta en este despliegue de silicio y refrigeración líquida. Sin embargo, el desafío se traslada ahora a los comités de dirección, que deben articular la transición operativa desde una IA diseñada para responder consultas hacia sistemas capaces de ejecutar procesos de decisión complejos con autonomía real. El interrogante que permanece abierto no es la capacidad del hardware, sino la velocidad con la que las organizaciones podrán integrar esta inteligencia ejecutiva en sus estructuras de gobernanza y control de riesgos.