Editor en La Ecuación Digital. Analista y divulgador tecnológico con…

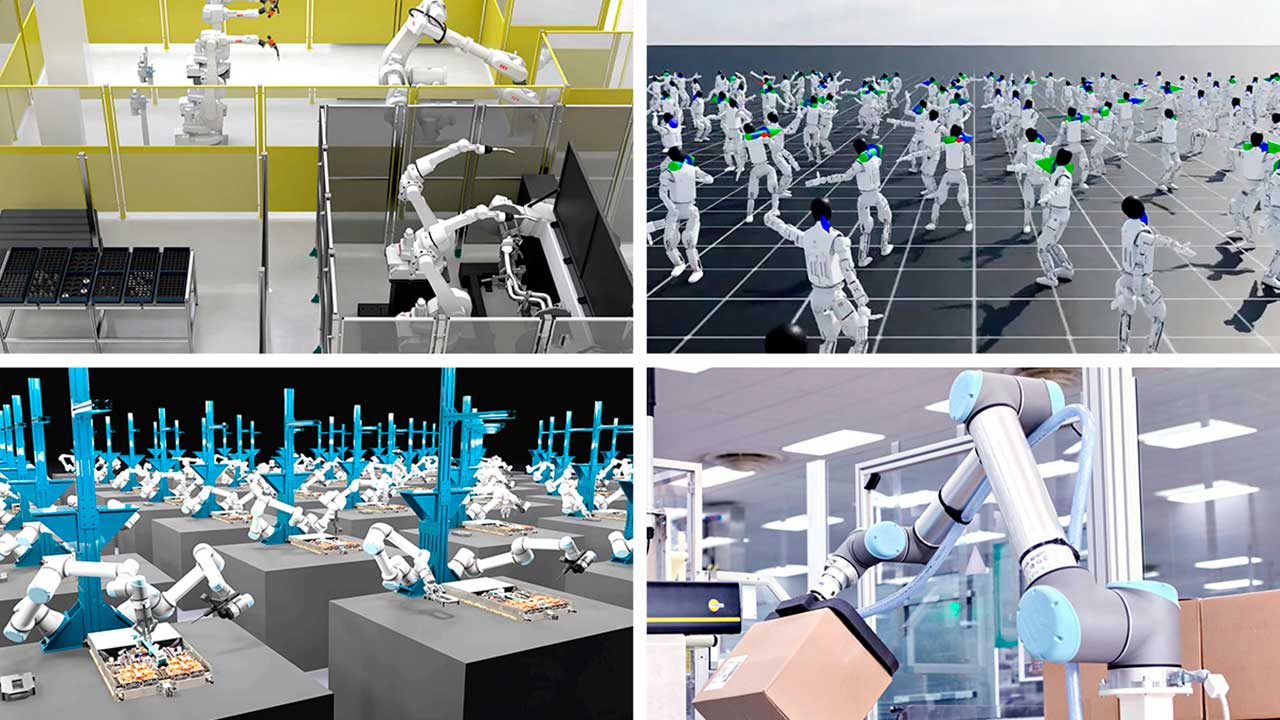

La inteligencia artificial ha pasado años confinada en los servidores, procesando lenguaje y píxeles para devolver respuestas en una pantalla. Sin embargo, el sector tecnológico atraviesa ahora un cambio de paradigma donde el código empieza a adquirir masa y volumen. La denominada IA Física (Physical AI) representa el esfuerzo por dotar a las máquinas de una comprensión intrínseca de las leyes de la naturaleza, permitiéndoles interactuar con el mundo real de forma autónoma.

Esta evolución no solo afecta a la forma en que se construye un robot, sino que redefine por completo la infraestructura de la manufactura moderna, planteando un interrogante fundamental: ¿es posible digitalizar la realidad con tal precisión que una máquina aprenda a operar en una fábrica antes de haber pisado el suelo de la misma?

El reciente despliegue de tecnologías en el marco del GTC 2026 de NVIDIA sugiere que la respuesta reside en la integración de tres pilares: modelos de mundo, simulación de alta fidelidad y factorías de datos. Jensen Huang, fundador y CEO de la compañía, sostiene que Physical AI ya es una realidad y que cualquier empresa industrial acabará convirtiéndose, de facto, en una empresa de robótica. Esta afirmación no es un simple eslogan; se apoya en una red de alianzas con los cuatro pilares de la robótica mundial: ABB Robotics, FANUC, YASKAWA y KUKA. Estas compañías, que suman una base instalada de más de dos millones de robots en todo el mundo, han comenzado a integrar bibliotecas de simulación y marcos de trabajo como NVIDIA Omniverse e Isaac en sus procesos de puesta en marcha virtual.

El gemelo digital como campo de entrenamiento

La manufactura de precisión, especialmente en sectores como la electrónica o la automoción, ya no permite el margen de error del ensayo y error físico. Aquí es donde los gemelos digitales dejan de ser representaciones visuales para convertirse en entornos de entrenamiento. Mediante el uso de herramientas de software industrial de gigantes como Siemens, Dassault Systèmes y PTC, las empresas están creando réplicas exactas de sus líneas de producción. Estos entornos no solo imitan la apariencia de una fábrica, sino que replican la fricción, la gravedad y las propiedades térmicas de los materiales.

La conexión entre el diseño asistido por ordenador (CAD) y la simulación se ha simplificado con la creación de puentes directos hacia formatos como OpenUSD. Según ha anunciado PTC, su plataforma Onshape ahora permite un flujo de trabajo que lleva el diseño desde la nube directamente a NVIDIA Isaac Sim.

Esto permite que equipos de ingeniería en empresas como FANUC America Corporation validen sistemas robóticos complejos en entornos digitales físicamente precisos antes de fabricar una sola pieza de metal. La eficiencia no reside solo en la velocidad, sino en la capacidad de probar escenarios límite o «edge cases» que serían peligrosos o costosos de replicar en el mundo físico.

Sin embargo, el verdadero desafío de la robótica actual no es la repetición de tareas, sino la generalización. Históricamente, un robot industrial ha sido una máquina excepcional para realizar una única tarea millones de veces. La nueva generación de «cerebros» robóticos, desarrollados por firmas como FieldAI o Skild AI, busca crear sistemas generalistas. Estos modelos utilizan lo que se conoce como modelos de mundo (world models) para generar datos y validar políticas de actuación.

El lanzamiento de NVIDIA Cosmos 3 ejemplifica esta tendencia al unificar la generación sintética de mundos con el razonamiento visual y la simulación de acciones. El objetivo es que cualquier robot, independientemente de su forma o función, pueda dominar nuevas tareas con un entrenamiento mínimo, adaptándose a entornos complejos que no han sido programados de forma rígida.

La irrupción del humanoide en la cadena de montaje

Uno de los puntos de mayor fricción y expectativa en la industria es el desarrollo de robots humanoides. Replicar la movilidad y la destreza humana es, posiblemente, uno de los retos de ingeniería más complejos de la década. Empresas como Boston Dynamics, Agility Robotics, Figure y la emergente AGIBOT están utilizando arquitecturas de aprendizaje a gran escala para acelerar esta transición. La clave aquí es el uso de modelos de lenguaje, visión y acción (VLA), como el nuevo GR00T N2, que permite a los robots tener éxito en tareas desconocidas con una tasa de acierto muy superior a los modelos anteriores.

Estos humanoides no están destinados únicamente a sustituir tareas pesadas, sino a coexistir en espacios diseñados para humanos. En las plantas de producción de Foxconn, por ejemplo, se están desplegando manipuladores de doble brazo entrenados con estas tecnologías para el ensamblaje de alta precisión de los servidores Blackwell. La inteligencia compartida permite que estas máquinas realicen tareas de manipulación diestra que antes eran exclusivas de los operarios humanos. Pese a los avances, la integración de estos sistemas en el flujo operativo diario todavía debe superar retos de latencia y seguridad funcional, algo que plataformas como NVIDIA Jetson Thor intentan resolver trasladando la inferencia de IA al edge o borde, directamente en el controlador del robot.

Datos sintéticos: la materia prima de la autonomía

Si el cómputo es el motor de esta revolución, los datos son el combustible. El problema es que los datos del mundo real son escasos, están desestructurados y son difíciles de etiquetar a la escala necesaria. La industria está pivotando hacia la creación de Physical AI Data Factories. Este concepto, detallado en los nuevos planos de arquitectura de referencia de NVIDIA, propone un sistema automatizado para curar, aumentar y evaluar datos de entrenamiento.

A través de la colaboración con proveedores de nube como Microsoft Azure y Nebius, los desarrolladores pueden transformar la potencia de cálculo en motores de producción de datos. Microsoft Azure, por ejemplo, ha integrado estas herramientas en su cadena de producción de IA física, permitiendo a empresas como Teradyne Robotics escalar sus canales de percepción y aprendizaje por refuerzo. La idea es simple pero ambiciosa: si no tienes suficientes grabaciones de un robot operando bajo una lluvia torrencial o en una zona de baja visibilidad, la simulación genera miles de horas de ese escenario específico para que la IA aprenda a reaccionar.

Esta capacidad de generar datos sintéticos físicamente precisos es lo que está permitiendo que sectores más allá de la manufactura adopten la IA física. En el ámbito sanitario, Medtronic y Johnson & Johnson MedTech exploran el uso de simulaciones basadas en Cosmos para entrenar sistemas quirúrgicos robóticos. La precisión exigida en una urología robótica o en una cirugía asistida por imagen no admite la variabilidad de los modelos de IA tradicionales; requiere un entorno donde cada colisión y cada interacción con el tejido esté validada por leyes físicas estrictas antes de llegar al quirófano.

Incluso el entretenimiento ha encontrado un hueco en esta arquitectura. Disney ha utilizado el simulador Kamino para entrenar las políticas de movimiento de sus droids Olaf y BDX. Estos robots han aprendido en entornos virtuales a gestionar su propio calor interno y a reducir el ruido de sus motores para interactuar de forma más natural con los visitantes de sus parques. Es un ejemplo de cómo la misma infraestructura que optimiza una fábrica de semiconductores puede aplicarse para mejorar la interacción humano-máquina en contextos recreativos.

La democratización de la IA física

Un aspecto relevante de esta transición es que ya no está limitada a los grandes conglomerados. La integración de marcos como Isaac y GR00T en ecosistemas de código abierto como LeRobot, de Hugging Face, abre la puerta a que millones de desarrolladores participen en la evolución de la robótica. Asimismo, programas de incubación como NVIDIA Inception están facilitando que startups como Standard Bots o Vention accedan a recursos de computación de alto rendimiento que antes eran prohibitivos.

El avance de la IA física también está forzando una evolución en el software de logística. KION Group y GXO están desarrollando soluciones de almacenes autónomos donde flotas de carretillas elevadoras, basadas en la plataforma Jetson, operan dentro de gemelos digitales de almacenes a gran escala. Esto permite optimizar las rutas y la seguridad antes de que la primera máquina empiece a mover pallets. La eficiencia operativa se convierte así en un subproducto de la simulación previa.

A pesar de la aceleración tecnológica, quedan incógnitas por despejar sobre la estandarización de estas plataformas y la interoperabilidad entre los diferentes proveedores de software industrial. Aunque el uso de OpenUSD parece estar ganando tracción como el lenguaje común para el metaverso industrial, la fragmentación del mercado sigue siendo un obstáculo para una implementación global sin fricciones. La cuestión que permanece abierta no es si la IA tendrá cuerpo, sino con qué rapidez las estructuras regulatorias y los modelos de negocio podrán asimilar un mundo donde la frontera entre lo virtual y lo físico se ha vuelto, por primera vez, funcionalmente irrelevante.

Editor en La Ecuación Digital. Analista y divulgador tecnológico con más de 30 años de experiencia en el estudio del impacto de la tecnología en la empresa y la economía.