Editor en La Ecuación Digital. Analista y divulgador tecnológico con…

La aceleración en el despliegue de modelos de lenguaje y agentes autónomos ha generado una brecha crítica en el control operativo de las grandes organizaciones. Mientras las direcciones de innovación presionan por integrar soluciones de inteligencia artificial generativa en cada proceso productivo, los departamentos de riesgos y cumplimiento se enfrentan a un mapa fragmentado de herramientas que, a menudo, operan fuera del radar oficial. Esta dualidad ha propiciado lo que en el sector empieza a denominarse como el caos de la IA, una situación donde la falta de visibilidad sobre los activos tecnológicos compromete la seguridad y la alineación con marcos legales como la AI Act europea.

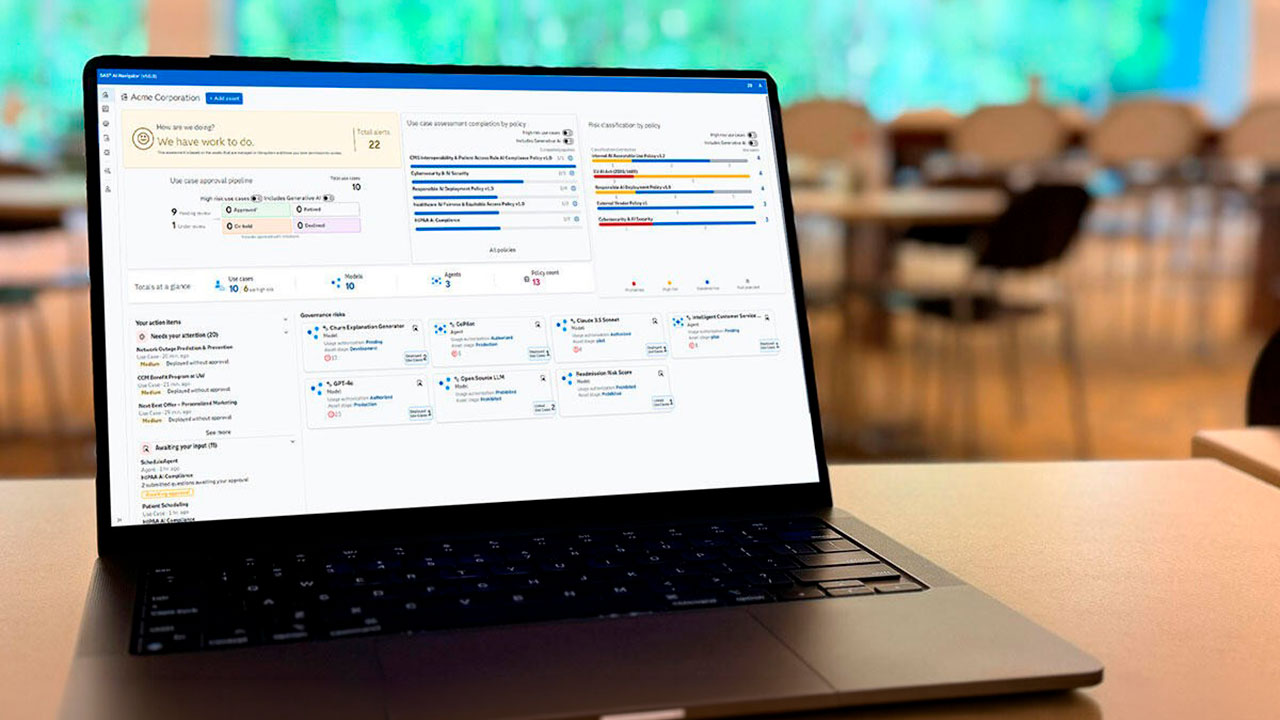

En este escenario, SAS ha presentado AI Navigator. No se trata de una herramienta de desarrollo adicional, sino de una plataforma SaaS diseñada para actuar como una capa de supervisión transversal. La propuesta busca resolver una de las mayores debilidades de la transformación digital actual: el inventariado de activos.

Muchas empresas desconocen hoy cuántos modelos están realmente en ejecución, quién los ha desplegado y bajo qué parámetros de seguridad operan. La solución permite catalogar casos de uso y supervisar el ciclo de vida completo de estos sistemas, desde la fase experimental hasta su retirada definitiva.

La complejidad no reside solo en los modelos propios, sino en la proliferación de la denominada IA en la sombra. El uso de herramientas externas por parte de empleados, sin supervisión del departamento de IT, abre flancos de vulnerabilidad que las métricas tradicionales de ciberseguridad no alcanzan a cubrir. Las previsiones de Gartner para finales de esta década sugieren que más del 40% de las corporaciones sufrirán incidentes derivados precisamente de este uso no autorizado. AI Navigator intenta atajar este problema ofreciendo una visión unificada del ecosistema, independientemente de si los modelos son de código abierto, propietarios o desarrollados por terceros.

Reggie Townsend, Vice President Ethics, Governance and Social Impact en SAS, señala que la gobernanza de la IA suele percibirse erróneamente como una medida puramente restrictiva o de cumplimiento. Sin embargo, el directivo sostiene que un marco sólido actúa realmente como un motor de crecimiento. «Un buen marco de gobernanza no restringe, sino que permite a los profesionales explorar todo el potencial de la IA dentro de un entorno estructurado, transparente y seguro», afirma Townsend. Esta visión traslada el debate desde la simple burocracia técnica hacia una ventaja competitiva basada en la fiabilidad de los resultados.

La integración es quizás el punto de mayor valor operativo para los responsables de tecnología en España. La plataforma no exige desmantelar las arquitecturas ya existentes ni modificar los flujos de trabajo de los equipos de datos. Se posiciona como una herramienta independiente que puede supervisar agentes de IA y grandes modelos de lenguaje (LLM) en el punto exacto donde generan impacto de negocio. Si una entidad financiera utiliza un chatbot avanzado para la atención al cliente, la plataforma no solo vigila el rendimiento técnico del modelo, sino que aplica políticas de cumplimiento para asegurar que las respuestas no vulneren normativas de protección de datos o transparencia.

Pese al empuje tecnológico, los datos de mercado reflejan una asimetría preocupante. Investigaciones de SAS e IDC indican que la inversión en adopción de agentes de IA avanza significativamente más rápido que el capital destinado a garantizar que esa misma IA sea confiable. Existe un riesgo latente de que las organizaciones construyan sus estrategias sobre cimientos frágiles. La gobernanza no es solo una lista de verificación; implica establecer mecanismos de interpretabilidad y detección de sesgos que, a menudo, se omiten en las fases de despliegue acelerado por la urgencia de mercado.

AI Navigator se apoya en capacidades previas de la firma de Carolina del Norte, como la gestión del riesgo de modelos y el enmascaramiento de datos. Para las empresas con distintos niveles de madurez digital, la flexibilidad de una solución SaaS permite escalar la supervisión según crezca el catálogo de soluciones implementadas. La meta es reducir la fricción técnica para que los marcos de responsabilidad no queden en papel mojado por su propia complejidad operativa.

Townsend es consciente de que la adopción interna de estas herramientas de control es el verdadero cuello de botella. «El mayor riesgo para cualquier programa de gobernanza de IA no es la regulación, sino contar con una herramienta tan compleja que nadie la utilice», admite. Por ello, el enfoque de la nueva plataforma se centra en que el camino hacia la responsabilidad técnica sea, en sus propias palabras, irresistible para el usuario final.

El cierre de esta brecha de gobernanza determinará la longevidad de las iniciativas de inteligencia artificial en el tejido empresarial español. La capacidad de auditar un modelo en tiempo real y asegurar que su comportamiento se alinea con la ética corporativa deja de ser un valor añadido para convertirse en un requisito de supervivencia. En un entorno donde las sanciones por incumplimiento y los errores algorítmicos pueden arruinar la reputación de una marca en horas, la centralización del control parece ser la única respuesta viable frente a la expansión descontrolada del código.

La tensión operativa ahora se desplaza hacia la implementación: cómo integrar estos sistemas de control sin ralentizar la innovación que el propio mercado exige. La respuesta de SAS con AI Navigator plantea que la transparencia no es el freno del algoritmo, sino el seguro que permite llevarlo a su máxima velocidad.

Editor en La Ecuación Digital. Analista y divulgador tecnológico con más de 30 años de experiencia en el estudio del impacto de la tecnología en la empresa y la economía.