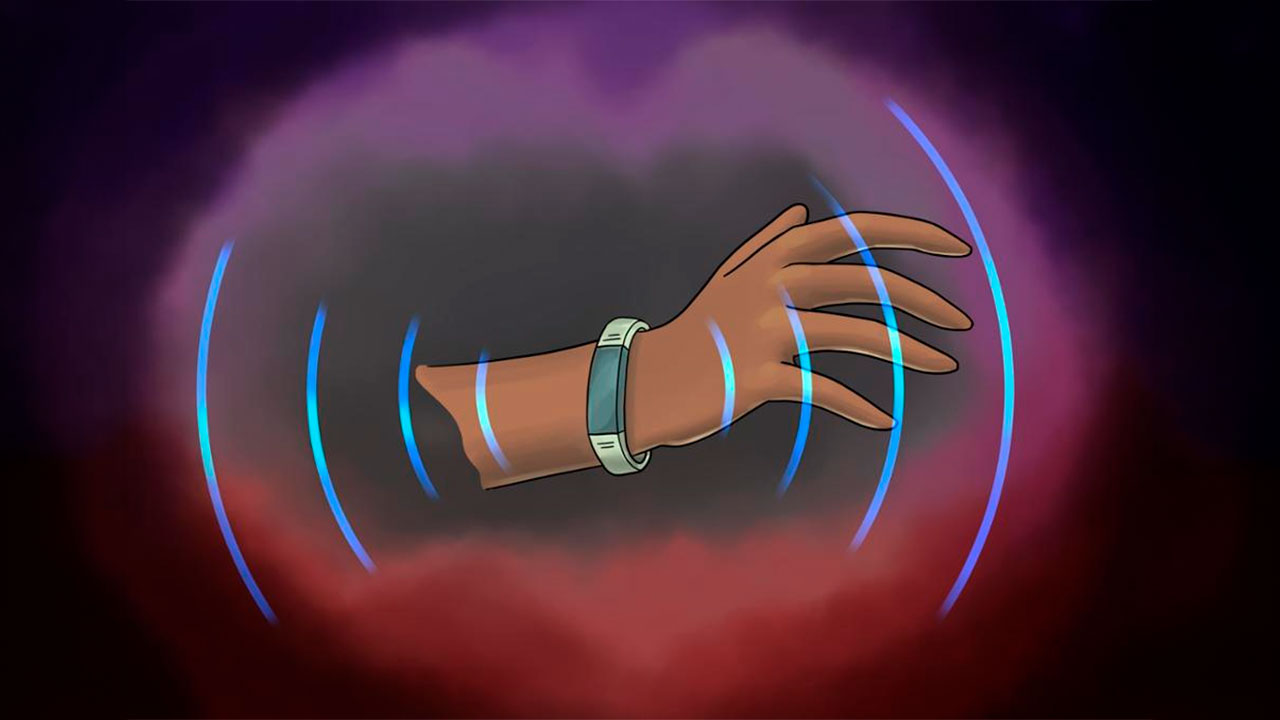

La capacidad de respuesta ante una situación de violencia de género ha dependido históricamente de la mediación humana o de dispositivos de alerta pasiva que requieren una acción consciente de la víctima. Sin embargo, el factor fisiológico ofrece una ventana de oportunidad distinta. La Universidad Carlos III de Madrid (UC3M), a través de su equipo multidisciplinar UC3M4Safety , ha dado un paso crítico en la evolución de Bindi, un ecosistema de tecnología vestible diseñado para detectar el miedo de forma autónoma.

La novedad no reside únicamente en la capacidad de monitorización, sino en el desplazamiento del procesamiento de datos desde grandes centros de computación remotos hacia el propio dispositivo que porta la persona. Este cambio de paradigma técnico, conocido como extreme-edge deployment, redefine no solo la eficiencia energética del sistema, sino también la soberanía y privacidad de la información sensible en contextos de vulnerabilidad.

El despliegue de algoritmos de aprendizaje profundo en microcontroladores de baja potencia representa un desafío de ingeniería que DeepBindi parece haber resuelto mediante una arquitectura optimizada. A diferencia de los enfoques convencionales que saturan las redes enviando señales biométricas en bruto a la nube, este avance permite que el análisis ocurra en el cuerpo del usuario. El sistema no se limita a observar; interpreta. La arquitectura convolucional implementada es capaz de discernir patrones en la dinámica de las respuestas fisiológicas, separando el ruido cotidiano de las reacciones específicas vinculadas a episodios de pánico o estrés extremo.

La arquitectura del miedo: Eficiencia en el borde

La viabilidad de este tipo de tecnología en el mercado profesional y de seguridad depende de su autonomía. Un wearable que agota su batería en pocas horas por el uso intensivo de la CPU es inútil en entornos de protección 24/7. Laura Gutiérrez Martín, investigadora de la UC3M y autora del estudio, destaca que la innovación no consiste en introducir la señal sin filtrar, sino en una extracción precisa de 57 características seleccionadas de señales como la temperatura cutánea, el volumen de pulso sanguíneo y la conductancia de la piel. Esta síntesis informativa permite que el modelo de IA ocupe menos espacio de memoria que una fotografía digital estándar, un hito que facilita su integración en redes de área corporal sin comprometer la velocidad de respuesta.

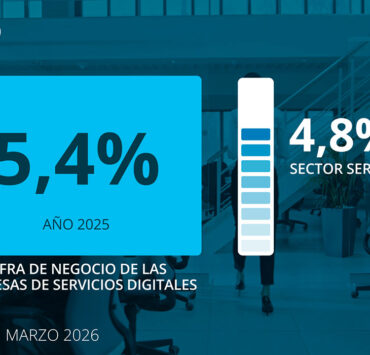

Esta reducción de la carga computacional no ha mermado la capacidad predictiva del algoritmo. Según los datos publicados en el «Journal of Biomedical and Health Informatics», el sistema ha alcanzado métricas de exactitud cercanas al 80%. Si se compara con las iteraciones previas del proyecto, la mejora de precisión se sitúa en un 26,4%. Aunque estas cifras son notables en el ámbito del aprendizaje profundo aplicado a la salud, abren interrogantes sobre el margen de error del 20% restante en situaciones donde la integridad física está en juego. La tecnología, por tanto, se posiciona como una herramienta de apoyo que requiere una infraestructura social y policial robusta detrás, capaz de gestionar las posibles falsas alarmas o las omisiones del sistema en estados emocionales ambiguos.

La operatividad de DeepBindi se basa en una secuencia de acciones automatizadas que se activan al detectarse el umbral de riesgo. El dispositivo envía una alerta a un círculo de confianza y, en caso de no recibir una confirmación de bienestar por parte de la usuaria, el protocolo escala hasta contactar con las autoridades. Aquí entra en juego otra derivada tecnológica fundamental: el cifrado de datos. Toda la información registrada durante el evento se almacena en un servidor seguro con el fin de servir como prueba en procesos judiciales. La trazabilidad de la respuesta fisiológica podría, en teoría, objetivar el relato de una agresión, aunque esta posibilidad introduce tensiones sobre la custodia de datos biométricos y la interpretación legal de un algoritmo como testigo de cargo.

Desafíos operativos y escala industrial

A pesar del optimismo que rodea a DeepBindi, financiado por la Agencia Estatal de Investigación y el INCIBE, su implementación a gran escala aún enfrenta obstáculos. Celia López Ongil, profesora del Departamento de Tecnología Electrónica de la UC3M, señala que el objetivo es detectar el miedo antes de que la agresión se consume, permitiendo una intervención inmediata. Sin embargo, la transición de un prototipo de laboratorio financiado con fondos públicos a un producto de mercado distribuido masivamente requiere una validación en entornos reales que el equipo busca completar mediante un piloto de mayor envergadura.

La versatilidad de la arquitectura de aprendizaje profundo utilizada sugiere aplicaciones que van más allá del ámbito de la violencia de género. José Ángel Miranda Calero, integrante del equipo investigador, apunta hacia la detección temprana del acoso escolar como una posible vía de expansión. Esta potencial diversificación del mercado para la tecnología de DeepBindi plantea un debate sobre la vigilancia biométrica constante y la normalización de dispositivos de escucha emocional en diferentes estratos de la sociedad. Si bien la tecnología ofrece una capa de seguridad inédita, su éxito comercial y social dependerá de la delicada balanza entre la protección activa y la intrusión en la privacidad biológica de los individuos.

En contraste con las soluciones de seguridad tradicionales, DeepBindi no es una entidad aislada, sino un nodo dentro de una red de apoyo más amplia. La tecnología por sí sola, como reconocen los propios investigadores, no resuelve problemas estructurales como la violencia de género, pero sí modifica la capacidad de reacción del sistema. La reducción de la latencia —el tiempo que transcurre desde que se inicia la respuesta fisiológica de miedo hasta que se emite la alerta— es el factor que puede determinar el éxito de la intervención. En el entorno del edge computing extremo, cada milisegundo ganado al procesar la información de forma local es un tiempo que se resta a la vulnerabilidad de la víctima.

El cierre de esta fase de investigación deja una hoja de ruta clara para la industria tecnológica española: la miniaturización de la inteligencia no es solo una cuestión de hardware, sino de optimización algorítmica. La capacidad de ejecutar modelos de aprendizaje profundo en chips de bajo coste abre la puerta a una nueva generación de dispositivos de protección personal que no dependen de una conexión estable a internet o de infraestructuras de red costosas. La tensión ahora se traslada a la capacidad de las instituciones para integrar estos flujos de datos automáticos en sus protocolos de emergencia, transformando una señal fisiológica en una respuesta operativa eficiente y jurídicamente vinculante.